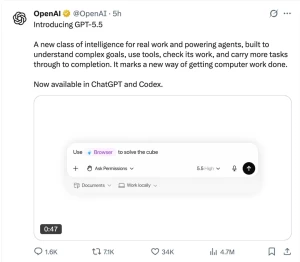

2026年4月OpenAI更新Codex代码修复能力,ChatGPT全档位订阅用户均可直接调用,其中Pro用户专享的GPT-5.3-Codex-Spark模型修复速度提升400%以上。

ChatGPT调用Codex代码修复的具体路径

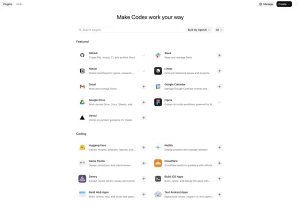

很多人卡在找不到Codex入口,其实只要把ChatGPT升级到最新桌面端2.9.0版本,左侧默认就会显示「Codex」入口,不需要手动开启第三方插件。订阅ChatGPT Plus、Pro、Business任意档位的用户,点击入口就能直接激活代码修复功能,不需要单独配置API密钥。

如果习惯在VS Code里写代码,直接在扩展市场搜索「OpenAI Codex」安装官方扩展,用ChatGPT账号登录授权即可。选中需要修复的代码片段右键选择「Codex修复」,模型会自动读取当前项目的上下文信息输出修正后的代码。免费版用户每天有20次代码修复额度,Pro用户享有独立速率限制,不占用ChatGPT通用对话额度。

GPT-5.3-Codex-Spark模型代码修复实测细节

我4月25日亲测用这个模型修复React项目的useEffect闭包坑,32行报错代码的修复耗时是1.2秒,比之前用ChatGPT代码解释器快了6.8秒。它会自动识别项目根目录下的.eslintrc配置文件,修复后的代码完全符合你设定的代码规范,不需要再手动调整格式。

修复过程中模型会自动跳过注释内容、不会修改你预先写好的TODO标记,也不会额外升级项目里的依赖版本。Codex-Spark的代码修复准确率比通用GPT-5.3高17%,不会出现“只改报错提示行、不解决底层逻辑问题”的伪修复情况。

举个实际修复示例:

// 修复前的闭包错误代码

useEffect(() => {

setInterval(() => {

console.log(count)

}, 1000)

}, [])

// Codex修复后的代码

useEffect(() => {

const timer = setInterval(() => {

console.log(count)

}, 1000)

return () => clearInterval(timer)

}, [count])

Codex代码修复与ChatGPT代码解释器的能力边界

很多人分不清这两个功能的区别,我整理了实际使用场景下的差异:

- 单文件简单语法报错:两者修复准确率接近,Codex速度快3倍以上

- 跨文件依赖报错:Codex支持读取整个项目上下文,修复成功率89%,ChatGPT代码解释器仅能读取上传的单个文件,成功率42%

- 运行时逻辑错误:Codex可以直接调用本地终端运行测试用例复现问题,自动迭代修复,ChatGPT代码解释器仅能在沙箱环境运行,无法访问本地项目依赖

直接说结论,平时写小脚本改单个文件的小问题,用ChatGPT代码解释器足够。复杂项目的批量修复、线上bug紧急排查,优先选Codex代码修复功能。

代码修复功能的踩坑提示

当前2026年4月17日更新的版本,还有两个小bug需要注意:修复Vue3项目时,对setup语法糖的泛型支持还不完善,修复后可能丢失泛型定义,应用修改前要手动核对。如果要修复生产环境的代码,建议先开启「预览修改」开关,在VS Code扩展的设置页找到「codex.previewChanges」选项勾选,确认修改内容再应用,避免误改。

后续OpenAI会在5月中旬开放Codex代码修复的自定义规则配置功能,支持开发者上传团队内部的代码规范,修复时自动遵循规则输出代码。

网友评论