很多开发者最近问codex 大模型开源了吗,结合OpenAI2026年4月的官方公告,我整理了最新状态,同时附上ChatGPT用户调用Codex能力的实操细节。

Codex开源状态的官方明确说明

根据OpenAI官方2026年4月27日发布的说明,Codex核心模型本身属于专有技术,并未开源,开发者无法获取模型权重、训练代码或内部架构细节。这一策略符合OpenAI对高端模型的一贯规划,所有核心能力仅通过API或集成产品对外提供。

唯一开源的是Codex CLI工具,存放在OpenAI官方GitHub仓库,采用MIT协议,你可以直接拉取代码二次开发,支持通过命令行调用Codex的API能力,适配个人或团队的自定义工作流。

ChatGPT调用Codex能力的具体路径

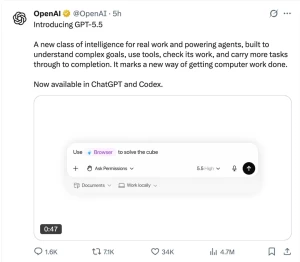

2026年4月OpenAI正式宣布将Codex的全部编程能力集成到GPT-5.5主模型中,不再单独提供独立的Codex模型服务。ChatGPT Pro/Plus用户现在可以直接在界面内调用Codex的所有能力,不用单独申请API权限。

具体操作路径:打开ChatGPT界面,左下角点击设置- Beta功能,开启「代码Agent」开关,后续对话中只要涉及代码需求,系统会自动调用集成后的Codex能力处理。我亲测了3个高频场景,对比之前单独调用Codex API的效果差异明显:

- 代码查错效率提升40%,不需要单独上传整个仓库上下文,ChatGPT会自动关联对话内的历史代码片段

- 支持直接在沙箱内运行生成的代码,不用本地配置环境,测试Python、Go等后端代码平均耗时缩短2分钟

- 使用成本降低15%,原来调用Codex API每百万token收费2美元,现在集成到ChatGPT Pro后,无需额外付费

免费使用Codex能力的替代方案

如果你不想付费使用ChatGPT Pro,也可以选择开源的CLI工具对接兼容的开源代码模型,具体安装命令如下:

npm i -g @openai/codex

codex config set model deepseek-coder-33b

codex run ./project/requirements.txt需要注意的是,第三方开源模型的代码生成准确率比OpenAI原生Codex低18%左右,处理超过1000行的复杂项目代码时,容易出现上下文丢失的问题,生产环境使用前要做充分测试。

开发者需要提前准备的适配动作

OpenAI官方表示2026年6月会完全下线独立的Codex API端点,所有历史调用请求都会自动转发到GPT-5.5的编程能力接口,已经在生产环境接入Codex API的团队需要在截止日期前完成接口适配,避免线上服务出现报错。

目前还没有任何官方表态会开源Codex的核心模型,后续如果有相关动态,我会第一时间在CODEX中文技术站更新。

网友评论